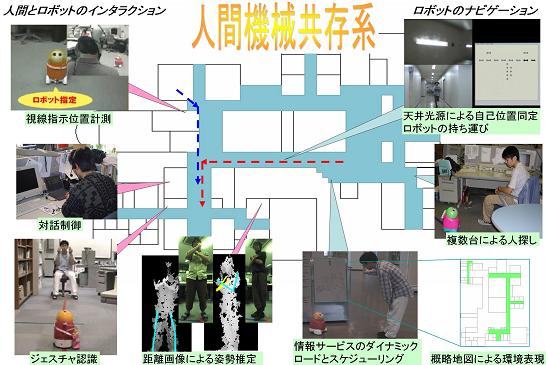

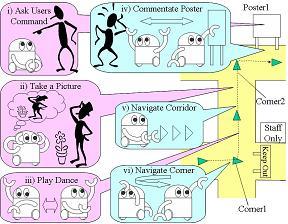

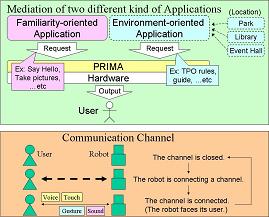

本研究は様々な環境に適応するパーソナルロボットのためのミドルウェアアーキテクチャを提供します. このアーキテクチャにより,環境に特化した情報サービスである Environment-oriented Application (EA) と,ロボット毎に備わったロボット特有の動作を表出する Familiar-oriented Application (FA) を共存して動作させることが可能となります. 独立に開発されたこれら2つのアプリケーションは,センサやアクチュエータを共有して適切な動作を行う必要があります. そこで本研究ではロボットの行動とその人間への影響を分析し,2つのアプリケーションを調停するミドルウェアを設計しPRIMA と名づけました.

[Kobayashi05, Kobayashi04, Kobayashi03b, Kobayashi03a, Kobayashi02]

(デモビデオ:EA例,FA例,調停例)

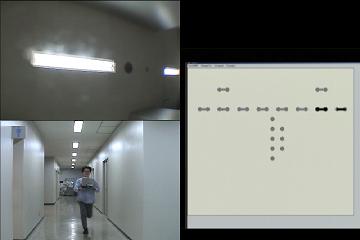

日常生活において自己位置情報は,室内移動ロボットやウェアラブルPCや歩行者ITS端末などで有効に利用できます. 本研究では天井光源を利用してカメラの高さ・姿勢の変化とユーザによるオクルージョンに対しロバストな自己位置同定を実時間で行うことができる手法を提案します. 天井に向いた単眼カメラで取得した画像中の天井光源の特徴を抽出して幾何学的な計算を行い,未知光源の天井光源地図における光源ID(識別情報)を特定することで大局的自己位置同定を行います. また本手法では通常は撮影された光源のID情報のみを特定し,アプリケーションからの要求があったときのみ特徴点の画像座標値と天井光源座標値の対応を利用し詳細な自己位置を計算します. [Maeda04]

(デモビデオ:DEMO1 DEMO2 DEMO3)

本研究は,ユーザによって作成された概略地図に基づいたロボットナビゲーションシステムを開発しました.概略地図とは,建物などによく見かける2 次元の建物の構造を表す案内地図と似た地図で,建物の廊下構造を正確に表しますが,正確な距離情報,幾何学的情報が期待できません.また,柱や壁の凹凸など,多くの詳細が省かれるという特徴があります.このような不正確さを許す地図は人間にとって簡単に作ることができますが,正確な地図を仮定する従来のロボットナビゲーションシステムに適用することは困難です.本システムでは,概略地図を利用するために,廊下の構造を抽出し,距離情報や幾何学的情報に依存しない拡張トポロジカル地図で環境を表現しました.また,ナビゲーションの際に,環境の部分的観察と地図の不正確さから生じる自己位置推定の曖昧さを解決するために,複数仮説による自己位置推定手法を利用します.このような作成が容易な概略地図を利用することで,ユーザに負担を与えることなく環境の地図を作成し,ロボットに与えることができます.これによって,ロボットは環境を探索することが不要となります.

[Setalaphruk03, Vachirasuk02]

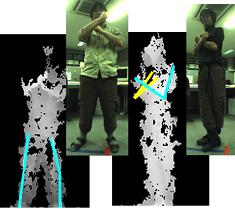

近年家庭内で動くロボットが登場し,日常の生活環境で人とロボットが接する機会が増えることが予想されます. 人とロボットが共存する環境では,ロボットが外界の様子を知る必要があり,ロボットが人物の姿勢推定をし,人物の様子を知ることは重要です. 本研究では,一箇所に設置した三眼ステレオカメラからのカラー画像と距離画像を入力とし,自己オクルージョンのある人物の三次元姿勢推定をするシステムを提案します. 姿勢推定で扱う姿勢は,人が立っている状態で,両腕と胴体,および両脚間のオクルージョンの発生を許すものです. 本研究において姿勢推定とは,手首,肘,肩,股関節,膝,足首の各関節の三次元位置とそれらの間の対応付けとします. 姿勢推定を行う手法は,各関節の候補となる領域を求め,各関節間で距離の連続性を計算し,関節間の対応付けを行い,自己オクルージョンを解決します. [Murakami02]

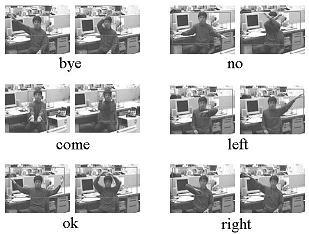

本研究では,一般のオフィス環境における遠隔操作のためのジェスチャ認識の自動化を目的として,任意の位置からの繰り返しパターンを持つジェスチャを認識する手法を提案し,実環境での動作を実現しています.従来のジェスチャ認識では,計算量の問題で実時間認識に不向きだったり,あらかじめ設定された位置からのジェスチャしか認識しなかったり,一人のジェスチャにしか対応しないものが多いです.提案手法では,一定の運動を繰り返す動作をジェスチャと仮定し,一定時間中のフレーム間差分画像の重ね合わせから動作領域を抽出し,抽出領域を3×3の9領域に分割しています.そして,フレーム間差分画像から得られるジェスチャ動作の動き情報を用いて,9個の分割領域間の特徴量の関係を相互相関係数により求め,ジェスチャの認識を行います. (Demo1(130MB),Demo2(!MB))